在当今这个信息爆炸的时代,越来越多的智能工具应运而生,而ChatGPT作为其中的佼佼者,正迅速改变着我们的工作和生活方式。可你是否曾经在使用它的过程中,遇到过一些让你困惑甚至失望的情况?为什么它能生成流畅的文章,却在某些简单的场景下“失灵”?它到底能做什么,又有哪些我们需要特别注意的局限性呢?在这篇文章中,我们将深入ChatGPT的局限性与应用边界,帮助大家更加清楚地了解这个强大工具的真正价值。

大家在使用ChatGPT时,肯定会惊叹它的语言流畅与丰富的词汇。但你有没有发现,某些时候,它在理解复杂语境或涉及细节的推理时,会显得不够精准?其实,这并不意味着ChatGPT“笨”,而是它的本质决定了它在某些方面的局限性。

由于ChatGPT并不具备真正的“理解”能力,它只是根据大量的语料库学习了语言模式,因此,在面对一些需要逻辑推理或深度理解的任务时,它往往无法提供准确的答案。例如,当你要求它分析一个具有深度背景的历史事件时,它能给你一个概括性的回答,但往往缺乏深入的洞察力。这也是很多用户在使用过程中遇到的“问题”之一。

我们可以利用实时关键词这一功能来弥补这种局限性。例如,借助西瓜AI的实时关键词挖掘功能,用户能够快速捕捉到当前的热门话题和动态,辅助ChatGPT生成更有针对性的内容,避免落入模板化的回答。

许多用户可能会误以为ChatGPT能在任何领域提供完美的答案,但实际情况并非如此。在某些高度专业化的领域,ChatGPT的表现可能会令你失望。比如医学、法律、金融等领域,虽然ChatGPT能给出一些基础性的知识,但其回答并不具备专业人士的严谨性和精确性。

更为关键的是,ChatGPT的知识库是基于训练数据的,而这些数据并非实时更新的。因此,它在面对一些最新的行业动态时,往往无法给出及时且准确的解答。如果你需要的是深度的行业分析或实时的市场趋势,依赖单一的ChatGPT显然是不够的。

不过,借助好资源AI的自动发布功能,大家可以将ChatGPT的内容迅速发布到多个平台上,扩展其应用场景,进一步提升其在信息传播中的价值。

尽管ChatGPT可以生成令人印象深刻的文章和内容,但它的回答有时可能并不完全准确或具有偏差。尤其是在一些社会性话题、文化议题等方面,ChatGPT有时会因为其数据训练集中的偏见,而输出带有误导性或错误的观点。

更严重的是,由于其没有独立的道德标准或判断能力,它可能生成不符合伦理规范的内容。虽然OpenAI对模型进行了不断的调整与优化,但仍然无法完全避免这种风险。

因此,大家在使用ChatGPT生成内容时,务必保持警觉,不要盲目依赖它,尤其是在涉及复杂情感、伦理或社会问题时,最好还是由人工进行审核与调整,确保最终输出的内容符合实际需求和社会规范。

虽然ChatGPT在创意写作方面表现不俗,但它依然面临着较大的挑战。举个例子,它可以根据给定的主题生成文章,但如果你要求它进行极具创意或情感色彩的写作,它往往无法达到人类创作者的灵动与独特。特别是在需要个性化表达、灵感碰撞和深度情感传达的创作任务中,ChatGPT可能会显得较为机械和单一。

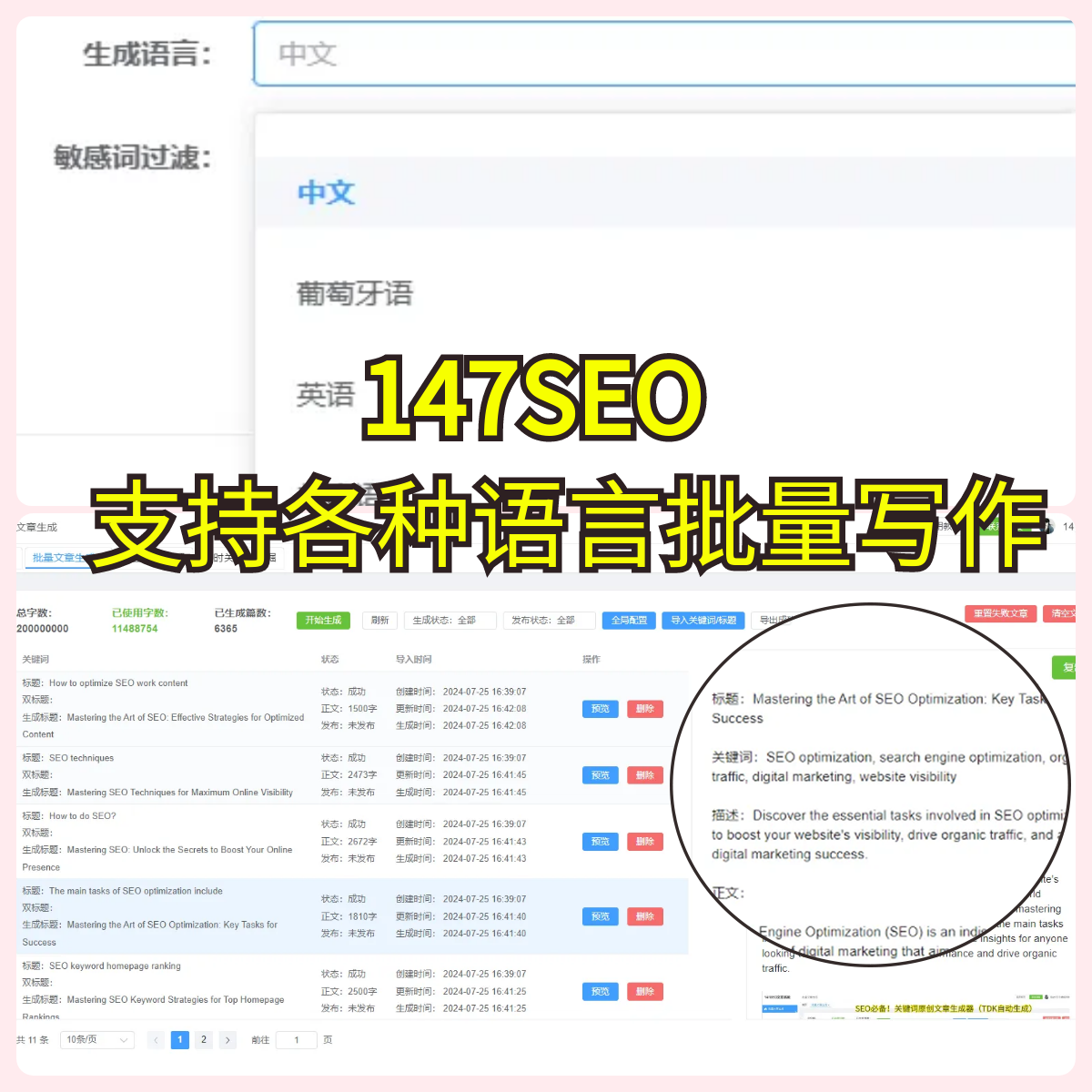

因此,当我们在进行一些创作工作时,应该把ChatGPT视为一种辅助工具,而非完全依赖它。比如,在撰写内容时,你可以利用战国SEO的功能,提前分析出你的目标受众正在关注的热点话题,然后结合ChatGPT生成初步的框架,再由你进行创意性的修改与填充,打造出符合自己风格的高质量作品。

从理解与推理能力到专业知识的局限,再到内容生成的偏差,ChatGPT在多个方面都有其明显的边界。这并不意味着我们应该完全抛弃这个工具,反而应该根据它的特点来合理地运用它。在未来的工作和生活中,ChatGPT将是一个值得我们利用的好帮手,但它仍然需要人类的智慧和判断力来发挥最大效能。

“工具只能为人类服务,而不能代替人类。” 这句话在今天依然适用。通过对ChatGPT的局限性与应用边界的理解,我们可以更加理智地运用它,让它成为我们工作和生活中的得力助手,而非无所不能的替代品。

相关问答推荐:

问:ChatGPT能提供专业领域的深度分析吗?

答:ChatGPT虽然在一些基础性知识方面表现优秀,但在高度专业化的领域,如医学、法律等,它并不能提供专业人士级别的分析,因此,仍然需要依赖行业专家的知识。

问:ChatGPT如何避免生成不准确或带有偏见的内容?

答:虽然ChatGPT的回答已经经过一定的优化,但由于其基于大量数据进行训练,依然可能会产生偏差。为了确保内容准确,建议在生成内容后进行人工审核与调整。